🧩 # 155 Hablemos del MCP (Model Context Protocol) (II)

Cuándo MCP tiene sentido de verdad (y cómo evitar que sea “otro conector más”)

¿Te gusta estar al día de las últimas novedades, tendencias y herramientas? ¿Quieres conocer cómo la transformación digital está cambiando la sociedad y las empresas? ¿Buscas inspiración, consejos y recomendaciones para innovar y crecer en el mundo digital?

Si la respuesta es sí, ¡esta newsletter es para ti!

Cada semana, te traemos una selección de contenidos prácticos, actualizados e interesantes, sobre la industria tecnológica, la Inteligencia Artificial, el Big Data, entre otros temas de relevancia mundial, mediante una propuesta diferencial, flexible, práctica y centrada en la experiencia.

En esta edición:

Hablemos del MCP (Model Context Protocol) (II)

El CGPJ fija las reglas del uso de IA por jueces

Redes sociales ante su primer gran juicio por “diseño adictivo”, mientras Europa cierra el cerco

Anthropic no se queda atrás: Opus 4.6

¿Y si pudieras hacer más en menos tiempo... sin cambiar tus herramientas de trabajo?

Tiempo de lectura: 7 min

📷 La imagen de la edición:

Prompt: A clean modern technical infographic diagram illustrating the MCP (Model Context Protocol) workflow. Left-to-right flow with connected rectangular blocks and arrows. Include labeled components: User, MCP Client App, LLM Model, MCP Server, External Tools (API, Database, Files). Show arrows representing message exchange: request, response, context injection, tool calls. Minimalist flat design, light background, soft blue and green color palette, modern UI icons, neat spacing, professional enterprise infographic style, vector illustration, high resolution, crisp lines, readable text.

Herramienta: Ideogram

🧠 Brain Pulse:

El tema de la semana:

🧩 Hablemos del MCP (Model Context Protocol) (II)

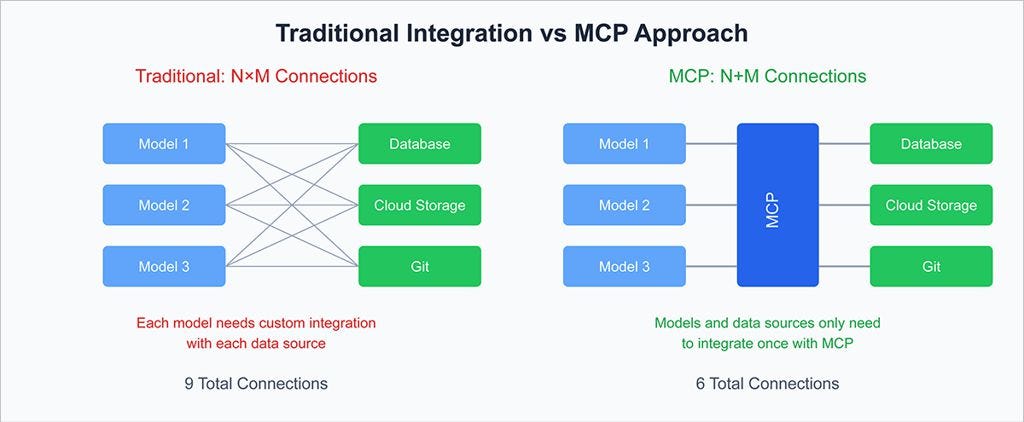

En la edición pasada definimos qué es el Model Context Protocol (MCP) y por qué está explotando: un estándar abierto (lanzado por Anthropic y adoptado ya por OpenAI, Google, Red Hat, AWS y decenas de miles de servidores comunitarios) que unifica cómo los clientes de IA (Claude, ChatGPT, copilotos, agentes) acceden a herramientas y datos externos. Como un USB-C para la IA.

Hoy toca lo que separa la curiosidad del valor real: cuándo MCP resuelve un dolor concreto en tu empresa… y cuándo solo maquilla el desorden existente. MCP brilla cuando detectas este patrón repetitivo:

Tienes varios “clientes” de IA (chat interno de soporte, copiloto en VS Code, agente de ventas, dashboard conversacional, etc.) que necesitan las mismas fuentes: documentación interna, tickets de Jira/ServiceNow, datos de CRM (Salesforce/HubSpot), reportes de BI (Looker/Tableau), catálogos de producto, bases de conocimiento en Notion/Confluence.

Cada equipo ha construido (o está construyendo) conectores parecidos: uno en Python, otro en Node, otro low-code con n8n/Zapier, y todos con autenticación casera, manejo de errores improvisado y cero reutilización.

Resultado: mantenimiento duplicado, actualizaciones pesadas cuando cambias modelo (Claude - Gemini - GPT), y dependencia de “el que sabe cómo funciona esa integración”.

Ahí MCP pasa de “estándar bonito” a herramienta operativa: creas un servidor MCP central (o varios virtuales) que expone las fuentes una sola vez. Los clientes se conectan vía protocolo estándar y reduces código duplicado, facilitas cambiar de LLM sin romper nada, y mejoras gobernanza desde el minuto uno.

Si tu realidad es alguna de estas, MCP puede amplificar el problema en vez de resolverlo:

Aún no hay claridad sobre propiedad de datos (“¿quién es dueño de este dataset?”), fuentes de verdad (¿qué versión de la política es la oficial?) o permisos mínimos

Estás en fase early prototipo: 2-3 experimentos aislados, sin uso productivo masivo.

En estos casos, implementar MCP es como ponerle turbo a un coche sin frenos: conectas más rápido… pero los accidentes también llegan más rápido (accesos no auditados, datos sensibles expuestos, acciones irreversibles por error).

Si decides avanzar, la implementación realista es menos épica y más precisa, olvídate de megaproyectos: empieza por casos read-only (consulta y búsqueda) antes de permitir escrituras o ejecuciones. Define qué expone el servidor y bajo qué condiciones, y desde el día uno incorpora lo mínimo para operar con calma: autenticación, permisos mínimos y registro de actividad (quién pidió qué y cuándo). No es burocracia: es lo que evita sustos.

El siguiente salto no es “conectar más cosas”, sino hacerlo mantenible. Trata el servidor MCP como un componente vivo: responsable claro, versiones, cambios controlados y pruebas básicas para detectar regresiones (un pequeño conjunto de consultas típicas que siempre deben responder bien). Si un día cambias de proveedor de IA o de interfaz, lo que quieres es que el acceso a herramientas y datos siga estable, predecible y auditable.

🗣️ Brain Bites:

Dos noticias que no te puedes perder:

— El CGPJ fija las reglas del uso de IA por jueces

El Consejo General del Poder Judicial (CGPJ) aprobó la Instrucción 2/2026 (acuerdo de 28 de enero, publicada en el BOE el 30 de enero de 2026) para establecer criterios y límites sobre el uso de sistemas de inteligencia artificial (incluida IA generativa) en la actividad jurisdiccional. El texto insiste en que la IA puede ser un apoyo, pero no puede operar de forma autónoma para decidir, valorar pruebas o aplicar el Derecho: el control humano efectivo y la responsabilidad exclusiva del juez son principios centrales.

En la práctica, la instrucción permite usar IA para buscar jurisprudencia/normativa, clasificar y estructurar documentación y generar esquemas o borradores de trabajo interno, y admite borradores de resoluciones solo con condiciones estrictas: deben provenir de sistemas facilitados por la Administración competente o el CGPJ, con revisión crítica y validación personal antes de incorporar cualquier contenido. También prohíbe usar herramientas no autorizadas para tratar datos judiciales (y limita su uso “privado” a tareas de estudio con fuentes abiertas), además de exigir prevención de sesgos, confidencialidad y medidas de seguridad/trazabilidad.

Si queréis profundizar más, os dejamos dos recursos generados con NotebookLM a partir del Acuerdo de 28 de enero de 2026:

— Redes sociales ante su primer gran juicio por “diseño adictivo”, mientras Europa cierra el cerco

La próxima semana inicia en Los Ángeles el primer juicio “bellwether” que pone a prueba si grandes plataformas (Meta/Instagram, YouTube y otras) pueden ser responsabilizadas no por el contenido publicado, sino por decisiones de diseño (autoplay, scroll infinito, recomendaciones, notificaciones) que presuntamente fomentaron adicción y daños en salud mental en menores. El caso (K.G.M., hoy de 20 años) es representativo de un litigio masivo: alrededor de 1.600 demandantes (más de 350 familias y cientos de distritos escolares) buscan demostrar que las compañías conocían los riesgos y no priorizaron salvaguardas; parte de la relevancia es que esta vía intenta sortear el “escudo” legal de la Sección 230 en EE. UU.

En paralelo, el frente regulatorio se endurece en Europa: la Comisión Europea ha comunicado hallazgos preliminares que señalan que el “diseño adictivo” de TikTok podría infringir la Ley de Servicios Digitales (DSA), con riesgo de multas de hasta el 6% de la facturación global y la exigencia de cambios estructurales (pausas efectivas, ajustes en recomendaciones, límites nocturnos, etc.). Y en España, Pedro Sánchez ha añadido presión política al debate al anunciar que el Gobierno impulsará la prohibición de acceso a redes sociales para menores de 16 años y exigirá verificación de edad efectiva a las plataformas, enmarcándolo como una respuesta al “salvaje oeste digital”.

El impacto: el foco pasa de “moderación de contenidos” a arquitectura de producto y métricas de engagement (retención, tiempo de uso, loops de recomendación). La presión regulatoria pueden acelerar cambios reales (o forzados) en funciones “pegajosas”, pero también abrir una etapa de fragmentación de reglas por país/estado que complicará qué pueden ofrecer y cómo las plataformas a los menores.

🦾 Toolkit:

Una sección dedicada a compartir herramientas, recursos y aplicaciones útiles para la comunidad de Brain and Code

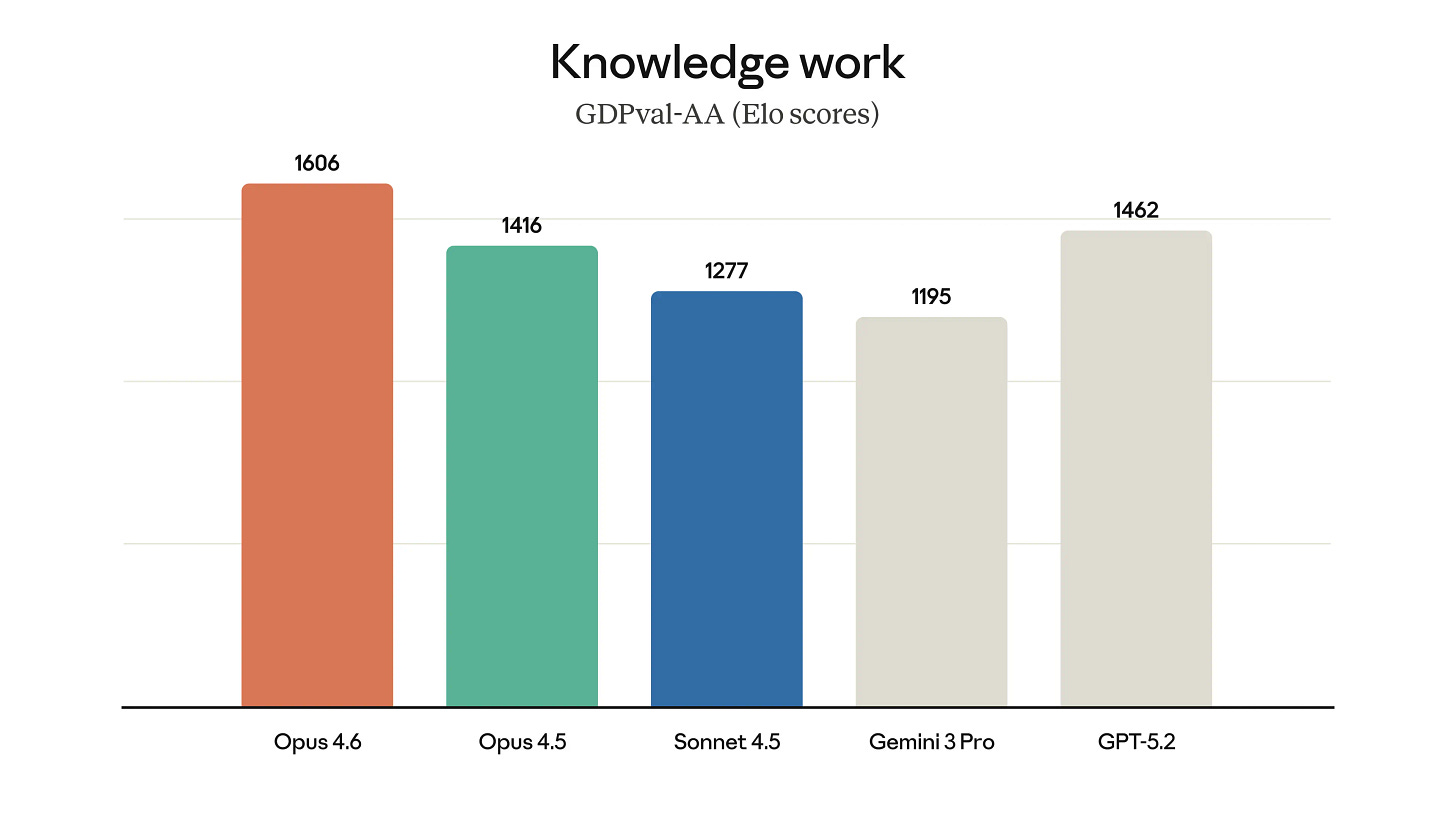

— Anthropic no se queda atrás: Opus 4.6

Recién llegado (5 de febrero de 2026), Claude Opus 4.6 es la nueva versión del modelo “más potente” de Anthropic y viene con una idea clara: que la IA sirva mejor para trabajos largos y complejos, no solo para responder preguntas sueltas. La novedad más llamativa es que, por primera vez en la familia Opus, ofrece un contexto enorme (hasta 1 millón de tokens, en beta): pensado para trabajar con mucha documentación o código sin tener que partirlo en trozos.

En la práctica, ¿qué cambia para ti? Sobre todo, que promete ser más útil cuando hay código de por medio: revisar cambios, detectar fallos, proponer correcciones y sostener sesiones más largas sin “perder el hilo”. Además, se apoya en funciones que te dejan ajustar el comportamiento: puedes pedirle que sea más rápido y directo o más cuidadoso cuando el problema lo requiere. Eso, bien usado, es lo que hace que sea herramienta y no juguete.

La parte menos sexy (pero la que decide si compensa) es el coste y la latencia. Si lo dejas en modo “muy cuidadoso” para tareas simples, tardará más y costará más ( premium pricing aplica >200k ($10/$37.50 por millón input/output)). Y ese contexto gigante tiene letra pequeña: a partir de cierto tamaño de entrada, el precio sube. Dicho simple: es un modelo para cuando de verdad estás trabajando con material grande o tareas exigentes, no para “cosas rápidas” de diario.

Si quieres saber en una tarde si vale la pena, haz tres pruebas reales: 1) dale un cambio de código o documento que te haya dado guerra y mira si te reduce rondas de corrección; 2) pásale un paquete grande de material (docs + notas) y comprueba si mantiene coherencia sin perder detalles; 3) repite lo mismo en modo “rápido” vs “cuidadoso” y quédate con el punto donde el resultado mejora, pero el coste no se dispara. Con eso decides si Opus 4.6 entra en tu stack o se queda como “modelo premium” para casos puntuales.

⚡ Corner:

Nuestra recomendación para esta semana:

— Programa Experto en Microsoft Copilot Ed. IV

Más información: https://brainandcode.tech/collections/cursos/products/programa-experto-en-microsoft-copilot-edicion-iv-febrero-2026

Cada día usas Word, Excel, Teams, Outlook, PowerPoint... Pero probablemente solo aprovechas una parte mínima de su potencial.

La IA generativa ya está integrada en tu ecosistema Microsoft. La pregunta no es si usarla, sino cómo hacerlo bien para:

✓ Automatizar tareas repetitivas que te roban horas cada semana

✓ Generar informes, presentaciones y análisis en minutos

✓ Colaborar de forma más inteligente con tu equipo

✓ Tomar decisiones basadas en datos sin ser experto técnico

Datos clave: 9 horas (6 sesiones de 1,5 h en 3 semanas), online en directo y con grabaciones en el Campus Brain para poder repasar. Incluye soporte (tutorías, recursos y updates). Además, es bonificable por FUNDAE.

Ficha rápida:

📍 Formato: Online en directo (sesiones grabadas para revisar nuevamente)

💰 Inversión: 450 €

💲Descuentos: Grupos: 5% de descuento extra en cada matrícula para matrículas de 3 o más personas. Alumni: 25% de descuento adicional por haber sido Alumni de cualquier programa en Brain and Code o MIDE.

📅 Inicio: 24 de febrero de 2026

Un programa de MIDE y Brain and Code

Porque la productividad real se mide en resultados, no en horas invertidas.