🧩 # 154 Hablemos del MCP (Model Context Protocol) (I)

El “USB-C” que empieza a ordenar las integraciones de IA

¿Te gusta estar al día de las últimas novedades, tendencias y herramientas? ¿Quieres conocer cómo la transformación digital está cambiando la sociedad y las empresas? ¿Buscas inspiración, consejos y recomendaciones para innovar y crecer en el mundo digital?

Si la respuesta es sí, ¡esta newsletter es para ti!

Cada semana, te traemos una selección de contenidos prácticos, actualizados e interesantes, sobre la industria tecnológica, la Inteligencia Artificial, el Big Data, entre otros temas de relevancia mundial, mediante una propuesta diferencial, flexible, práctica y centrada en la experiencia.

En esta edición:

Hablemos del MCP (Model Context Protocol)

Yann LeCun se suma a Logical Intelligence y vuelve a empujar alternativas “más allá del LLM”

Microsoft presenta Maia 200, su chip propio

Gemini Gems (Knowledge): Multi-formato (II)

NUEVO: Programa Experto en Automatización con IA en n8n

Tiempo de lectura: 7 min

📷 La imagen de la edición:

Prompt: A clean, modern diagram illustrating the Model Context Protocol (MCP) architecture with interconnected nodes and data flow pathways. The central hub displays "MCP" in bold sans-serif lettering, surrounded by geometric representations of AI models, servers, and client applications connected by flowing lines and arrows. The design uses a professional blue and white color scheme with subtle gradients, set against a minimalist background with soft grid patterns. Technical annotations and connection labels are scattered throughout the diagram, emphasizing the protocol's role in facilitating communication between different AI systems and applications. Formato 16:9

Herramienta: ChatGPT

🧠 Brain Pulse:

El tema de la semana:

🧩 Hablemos del MCP (Model Context Protocol) (I)

Hay una señal clara de madurez: cada vez más equipos preguntan “¿cómo conectamos esto (una herramienta) con nuestros sistemas?”. En cuanto entras ahí, aparece el mismo patrón: integraciones a medida, conectores duplicados, permisos difíciles de explicar y un “peaje” de mantenimiento que crece con cada nueva herramienta de IA que entra en la organización.

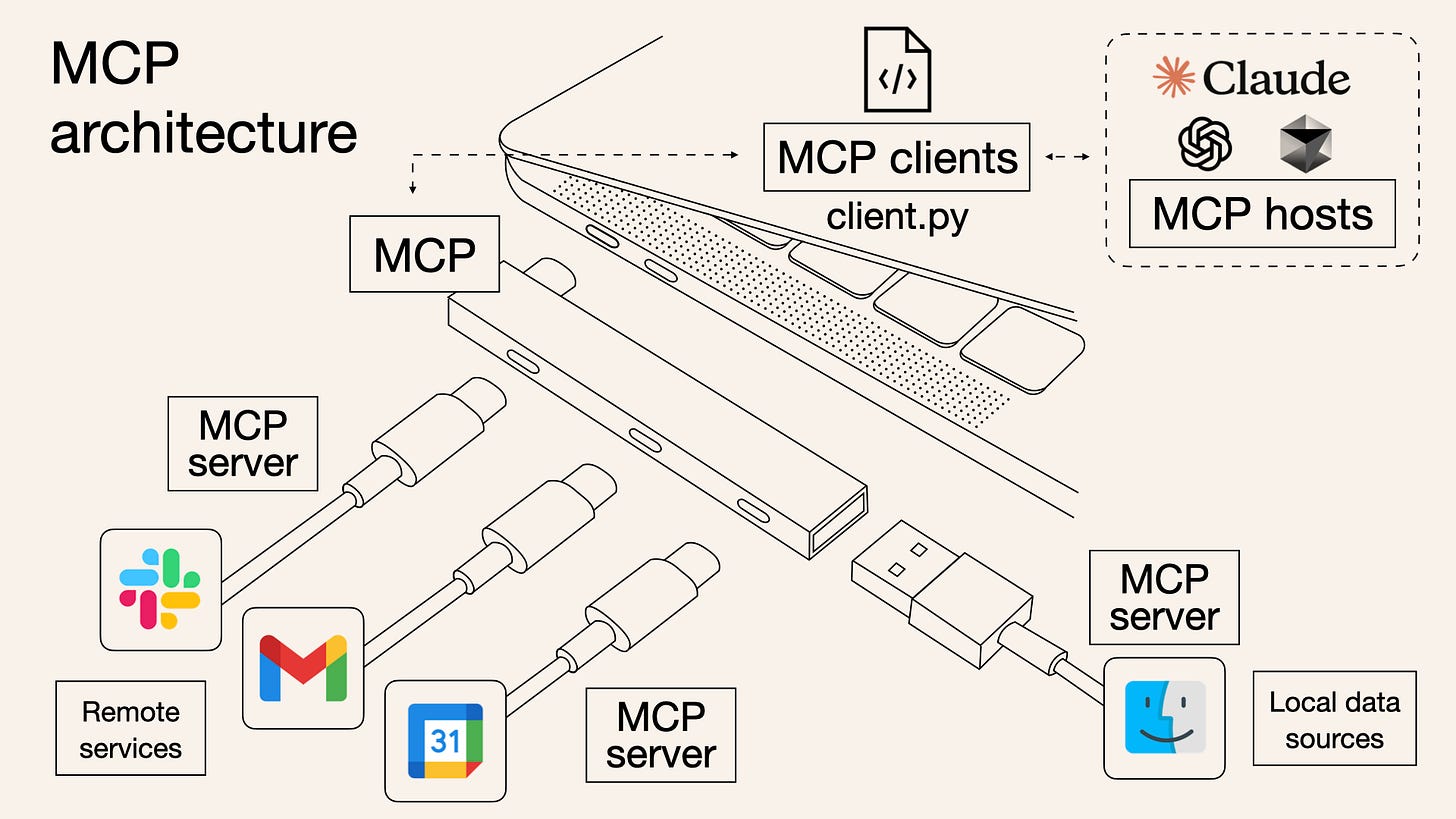

Aquí aparece el MCP (Model Context Protocol) que es, en esencia, un estándar abierto para que un cliente (un asistente, un agente, un IDE…) se conecte a servidores que exponen herramientas y fuentes de datos de forma consistente. La idea se lanzó públicamente cuando Anthropic lo “open-sourceó” el 25 de noviembre de 2024: un protocolo para conectar asistentes a “donde vive el dato” (repositorios, herramientas de negocio, entornos de desarrollo).

¿Por qué está ganando tracción ahora? Porque la IA está dejando de ser un generador de texto y se está convirtiendo en una capa de interacción con herramientas (que ya lo habéis leído por aquí). En las últimas semanas, por ejemplo, Claude ha ampliado integraciones interactivas con apps como Slack, Figma, Canva o Asana apoyándose en MCP. En paralelo, Microsoft documenta soporte integrado de conectores MCP en Copilot Studio (con un catálogo de servidores/conectores ya listados). Y OpenAI describe compatibilidad con MCP en su Agents SDK, precisamente para reutilizar servidores MCP existentes o construir los propios. Lo anterior, se entiende quizás mejor con una imagen (ya sabéis lo que se dice: “una imagen vale más que mil palabras)

Otra pista de que no es “una moda más”: en diciembre de 2025, Anthropic anunció la donación de MCP a la Agentic AI Foundation bajo la Linux Foundation, buscando gobernanza neutral y continuidad del estándar; la Linux Foundation también lo presentó como proyecto fundador. En pocas palabras: varias compañías compiten en modelos, pero les interesa que el “enchufe” sea común.

Ahora bien, MCP no te ahorra pensar en seguridad. Al revés: como facilita conectar herramientas, puede ampliar superficie de ataque si se usa sin controles. De hecho, recientemente se reportaron vulnerabilidades en el servidor oficial “Git MCP” que se parchearon, recordatorio de que el riesgo no desaparece por estandarizar. MCP ordena el “cómo conectas”; no resuelve por sí solo el “qué permites” y “bajo qué condiciones”.

¿Cómo llevarlo a cabo de forma realista (sin convertirlo en un proyecto infinito)? Empieza donde MCP aporta más: contexto y acciones repetibles. Si estás en ecosistema Microsoft, revisa primero qué conectores MCP ya te da Copilot Studio y prueba un caso inicial (buscar en SharePoint/OneDrive, consultar perfiles, recuperar documentación) antes de permitir escrituras o ejecuciones. Si estás fuera, la lógica es similar: elige un único sistema “fuente de verdad” (por ejemplo, knowledge base o repositorio de tickets), expón solo las operaciones mínimas como servidor MCP, y define qué queda en modo “sugerir” vs “hacer” (lo segundo requiere permisos y trazabilidad).

No os preocupéis, seguiremos hablando de este tema en la próxima edición :)

🗣️ Brain Bites:

Dos noticias que no te puedes perder:

— Yann LeCun se suma a Logical Intelligence y vuelve a empujar alternativas “más allá del LLM”

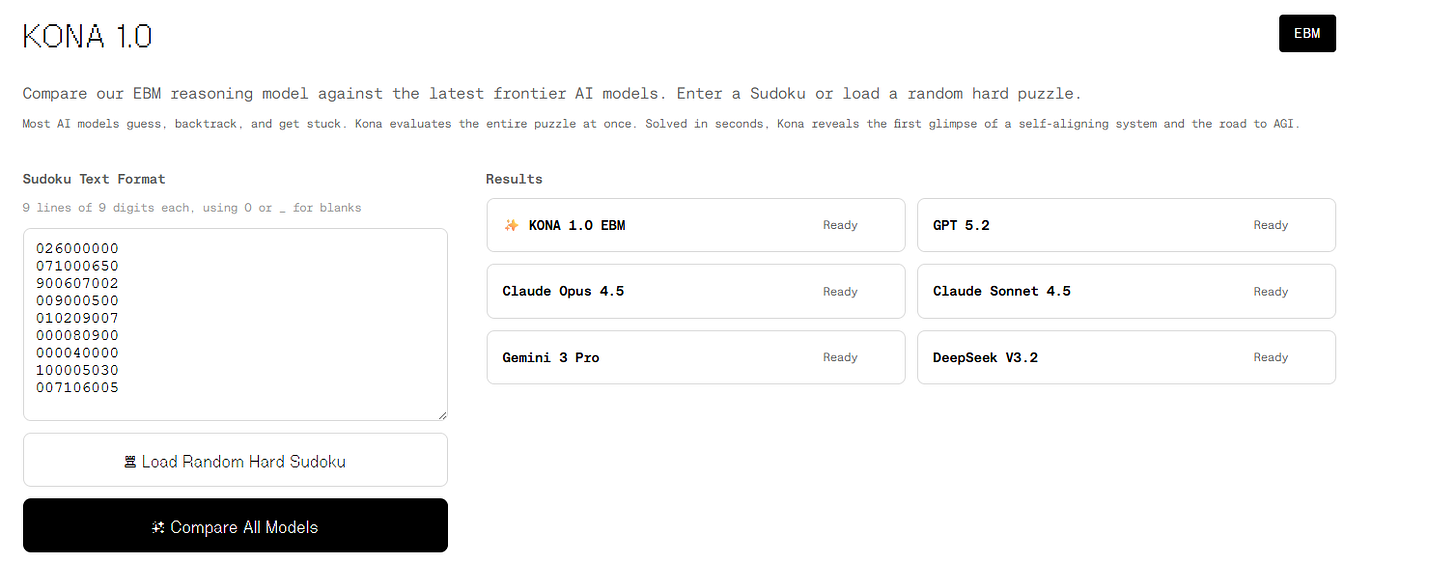

La startup Logical Intelligence presentó Kona 1.0, un modelo de razonamiento basado en energy-based models (EBM), y anunció la incorporación de Yann LeCun a su liderazgo. El posicionamiento es directo: mientras el mercado invierte cientos de miles de millones en escalar LLM, ellos apuestan por un enfoque distinto para tareas de razonamiento y optimización, con pilotos previstos en sectores como energía, manufactura avanzada y semiconductores.

La compañía sostiene que Kona puede resolver problemas tipo sudoku más rápido que LLM “top” corriendo en una sola Nvidia H100, y plantea un “stack modular” donde los LLM se usan para lenguaje, los EBM para razonamiento y otros componentes para interacción con el mundo. Y, enlazando con lo que ya comentamos en una edición anterior: este movimiento encaja con la etapa de LeCun tras dejar Meta, reforzando su línea pública de que escalar texto no basta para alcanzar sistemas más robustos.

El impacto: enfoques tipo EBM demuestran ventajas reproducibles (menos alucinación, más control, menor coste) pueden ganar espacio en casos donde el error es caro (industria, energía, planificación). Pero hoy está en fase temprana: lo accionable es vigilar benchmarks públicos, evidencia de pilotos que permita evaluar estas técnicas como complemento de LLM en producción, no como reemplazo inmediato.

— Microsoft presenta Maia 200, su chip propio

Microsoft ha anunciado esta semana a Maia 200, su acelerador de IA de segunda generación enfocado en inferencia (la “producción” de respuestas y tokens en aplicaciones como copilotos y chatbots). Está fabricado en TSMC 3 nm y Microsoft lo describe como una pieza clave para mejorar la economía de servir modelos a escala, empezando por despliegues en Azure (región US Central) y equipos internos.

A nivel técnico, el mensaje es que esto va de sistema: Maia 200 combina optimizaciones para FP4/FP8, una arquitectura de memoria pensada para “razonamiento” y un diseño de infraestructura para ejecutar modelos grandes de forma más eficiente. La compañía asegura mejoras frente a su hardware previo y lo coloca explícitamente en la carrera contra el silicio propio de Amazon (Trainium) y Google (TPU), señalando que el cuello de botella ahora es coste y disponibilidad, no solo capacidad de entrenamiento.

El impacto: Maia 200 significa que el “precio por token” y la latencia de servicios de IA en Azure pueden bajar sin esperar a la próxima generación de Nvidia.

🦾 Toolkit:

Una sección dedicada a compartir herramientas, recursos y aplicaciones útiles para la comunidad de Brain and Code

— Gemini Gems (Knowledge): Multi-formato (II)

Como complemento del artículo de la semana pasada (donde hablábamos de vídeos en Drive como conocimiento para Gemini), hay otra pieza que encaja todavía mejor cuando ya tienes “fuentes curadas”

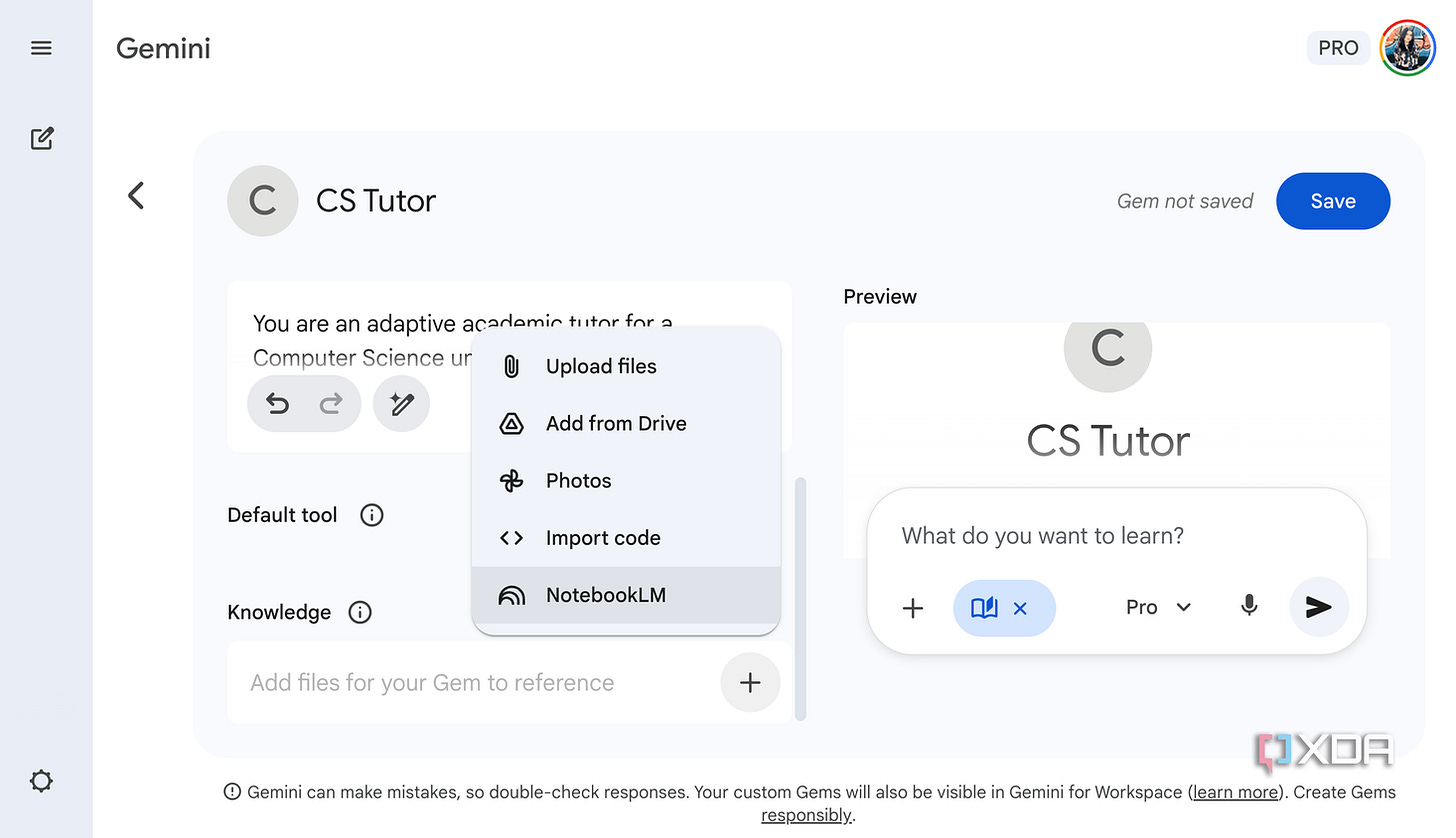

Ahora puedes usar un cuaderno de NotebookLM como fuente dentro de Gemini y, desde ahí, añadirlo a un Gem. En la práctica, esto convierte tus cuadernos (que ya están curados) en un bloque de conocimiento reutilizable: mismo contexto, menos duplicación y menos mantenimiento.

¿Por qué aporta tanto? Porque un cuaderno de NotebookLM no es “un archivo”, es una colección de fuentes (PDF, Google Docs, webs, vídeos de YouTube, audio, etc.) que NotebookLM ya sabe sintetizar con trazabilidad. Ahora puedes llevar ese “pack” a Gemini para obtener respuestas más fiables y ancladas en las fuentes del cuaderno, en vez de depender de memoria de chat o de adjuntos dispersos.

Cómo usarlo sin liarla: en Gemini, añade el cuaderno desde el botón “+” y selecciona NotebookLM, seleccionas el cuaderno correspondiente que aporta conocimiento al Gem y listo; y si trabajas con Workspace, fíjate porque esto depende de que NotebookLM esté habilitado por tu admin.

⚡ Corner:

Nuestra recomendación para esta semana:

— Programa Experto en Automatización con IA en n8n

En 2026, la diferencia no la marca “tener IA”, sino tenerla conectada. La mayoría de equipos ya viven en un ecosistema de herramientas (CRM, email, hojas de cálculo, formularios, mensajería…), y si no hay integraciones y una capa de orquestación, la IA se queda en ideas sueltas: responde bien, pero no ejecuta, no registra, no avisa y no mejora el sistema. Ahí es donde encaja n8n: una plataforma de automatización de workflows que combina automatización de procesos con capacidades de IA.

Por eso hemos creado este programa: para que aprendas a diseñar y desplegar automatizaciones end-to-end con n8n, integrando herramientas digitales, canales de comunicación, CRMs y agentes de IA, sin necesidad de programar. La meta no es que hagas “flujos bonitos”, sino que construyas sistemas que reduzcan trabajo repetitivo y aumenten la calidad del dato (y, con ello, la capacidad de decisión).

Durante 6 sesiones prácticas vamos de lo esencial a lo operativo: fundamentos y mentalidad de automatización (workflows, triggers, webhooks, control de flujo), captura y estructuración de datos (Sheets, validación), comunicación automática (Gmail/SMTP, alertas), integración con CRM (HubSpot/ActiveCampaign y enriquecimiento vía APIs), automatizaciones avanzadas y reporting (sub-workflows, cron, reportes), y cierre con agentes de IA y un ejercicio final para consolidarlo todo en un caso real.

Más información: https://brainandcode.tech/products/programa-experto-en-automatizacion-con-ia-en-n8n

Datos clave: 9 horas en total (6 sesiones de 1h30), online en directo y con grabaciones en el Campus Brain para poder repasar. Incluye certificado + badge y soporte (tutorías, recursos y updates). Además, es bonificable por FUNDAE.

Ficha rápida:

📍 Formato: Online en directo (sesiones grabadas)

💰 Inversión: 385 € (aplicado 30% desc. sobre 550 €)

📅 Fechas: Inicio 17/03/2026