🛠️ # 118 Herramientas: el verdadero reto no es usarlas, sino decidir quién las usa, cómo y para qué

La cuestión no es qué herramienta nueva puedes probar esta semana. Es cómo vas a diseñar un sistema de decisión y distribución tecnológica que no dependa del caos o la moda.

¿Te gusta estar al día de las últimas novedades, tendencias y herramientas? ¿Quieres conocer cómo la transformación digital está cambiando la sociedad y las empresas? ¿Buscas inspiración, consejos y recomendaciones para innovar y crecer en el mundo digital?

Si la respuesta es sí, ¡esta newsletter es para ti!

Cada semana, te traemos una selección de contenidos prácticos, actualizados e interesantes, sobre la industria tecnológica, la Inteligencia Artificial, el Big Data, entre otros temas de relevancia mundial, mediante una propuesta diferencial, flexible, práctica y centrada en la experiencia.

En esta edición:

Gobernanza de herramientas

Un movimiento que puede cambiar el tablero

GPT 4.1 para todos

Musk, China y los robots

Faltan pocos días para AI Expert IX

Súmate a nuestro canal de YouTube

Tiempo de lectura: 6 min

📷 La imagen de la edición:

Prompt: A conceptual editorial illustration in 16:9 format symbolizing the ethical challenge of generative AI tools. A futuristic scene shows two or more human silhouettes facing a glowing, abstract AI interface — a floating orb, a neural network, or a morphing screen of light and code. The figures differ in age, attire, or intent, representing conflicting motivations: creativity, control, manipulation, innovation. The AI interface hovers neutrally in the center, its glow casting shadows and dividing the space. The composition suggests a moment of decision: not how to use AI, but who gets to use it, and for what. Clean futuristic setting with minimal background, editorial style, soft gradients, symbolic lighting. Slightly surreal atmosphere, horizontal 16:9 format.

Herramienta: ChatGPT 4o

🧠 Brain Pulse:

El tema de la semana:

🛠️ Herramientas: el verdadero reto no es usarlas, sino decidir quién las usa, cómo y para qué

Uno de los errores más frecuentes en la adopción de tecnologías —y más aún con la inteligencia artificial generativa— es pensar que la clave está en la herramienta. Lo difícil, sin embargo, no es tener acceso, sino tener criterio. Criterio para decidir quién usa qué, en qué etapa del proceso, con qué propósito, y bajo qué supuestos de validación y supervisión.

Porque si bien el discurso dominante nos habla de “democratización del acceso”, la realidad es que una organización sin gobernanza solo distribuye desorden con más velocidad.

La cuestión no es qué herramienta nueva puedes probar esta semana. Es cómo vas a diseñar un sistema de decisión y distribución tecnológica que no dependa del caos o la moda.

La mayoría de las organizaciones están tomando decisiones reactivas: prueban, sueltan, integran parcialmente, y luego se preguntan por qué sus flujos son inconsistentes o por qué los errores se reproducen.

¿Por qué? Porque el sistema sigue siendo tool-driven: gira en torno a lo que la herramienta puede hacer.

Pero lo que se necesita ahora es una cultura criteria-driven: una organización que sepa:

Distinguir entre tareas de alto riesgo y bajo riesgo.

Identificar qué procesos requieren validación humana explícita.

Reconocer que no toda delegación tecnológica es delegación legítima.

Decidir qué capacidades deben ser desarrolladas antes de permitir el uso de una IA.

Cuando hablamos de gobernanza, no estamos hablando de un documento PDF con lineamientos que nadie consulta. Estamos hablando de una práctica sostenida, compartida, que establece:

Un sistema de asignación de herramientas por función, contexto y nivel de autonomía.

Protocolos de validación y supervisión humana.

Flujos de revisión iterativa de errores, límites y aprendizajes.

Espacios para que los equipos documenten cómo usan la IA, para qué, y qué preguntas siguen sin resolver.

Y todo esto no como “una carga extra”, sino como parte del mismo acto de trabajar con IA. Porque no es madurez digital si no incluye estructura ética, operativa y contextual.

Por supuesto, hay muchos marcos/frameworks de gobernanza, os dejamos uno de ellos:

Una organización que decide no gobernar sus herramientas está delegando el criterio al azar. Permite que las tecnologías no solo medien los procesos, sino que los definan sin negociación. El problema no es que una IA redacte un informe. El problema es que nadie sepa si lo ha hecho, bajo qué premisas, con qué fuentes, y con qué margen de error aceptado.

Por eso, el centro de esta conversación no es tecnológico, sino político en el sentido más profundo del término: cómo se distribuye el poder de decisión dentro del trabajo asistido por inteligencia artificial. ¿Quién puede decidir automatizar? ¿Quién valida lo que se automatiza? ¿Qué tareas, por su naturaleza ética, humana o contextual, deben quedar fuera de cualquier flujo automatizado?

La gobernanza de herramientas no es un apéndice. Es el corazón del nuevo diseño organizacional. No basta con formar en uso de IA. Hay que formar en criterio para usarla. No basta con documentar errores. Hay que registrar decisiones. No basta con innovar. Hay que saber para qué se innova y a costa de qué.

Sin esa conciencia estructural, las herramientas seguirán funcionando, pero lo harán como capas superpuestas sobre sistemas frágiles. Y entonces, los beneficios aparentes —productividad, velocidad, eficiencia— serán solo una simulación temporal.

Gobernar las herramientas, entonces, es gobernar el trabajo. Y en la era de la inteligencia artificial, lo verdaderamente inteligente será saber cómo hacerlo.

🗣️ Brain Bites:

Dos noticias que no te puedes perder:

— Un movimiento que puede cambiar el “tablero”

OpenAI y Microsoft están negociando algo más que un acuerdo económico: están reescribiendo las reglas de una alianza que podría marcar el futuro del mercado de inteligencia artificial. Según revela Financial Times, ambas compañías están inmersas en conversaciones para rediseñar los términos de su relación, en un momento clave en que OpenAI busca transformarse en una corporación de beneficio público y allanar el camino hacia una futura salida a bolsa. Pero cuando la misión fundacional choca con el capital, la tensión ya no es solo contractual, es filosófica.

Microsoft ha invertido más de 13.000 millones de dólares en OpenAI, y su tecnología está profundamente integrada en productos como Copilot o Azure. Sin embargo, la startup liderada por Sam Altman está acelerando su autonomía: explora nuevas alianzas, diversifica sus canales de comercialización y proyecta una estructura jurídica más abierta a los mercados, sin perder su narrativa fundacional.

Recordemos un esquema que refleja su “acuerdo” inicial, que por supuesto se ha venido actualizando en la medida que OpenAI lanza nuevos modelos y funcionalidades:

Las conversaciones actuales no solo buscan definir participación accionarial o derechos sobre los modelos futuros. Se trata de algo más delicado: negociar hasta qué punto es posible escalar una tecnología con vocación transformadora sin que el capital condicione su propósito. Como veis, el resultado de esta negociación no solo marcará el futuro de OpenAI tendrá un impacto mucho más “social”.

— Musk, China y los robots

La tensión entre Estados Unidos y China ha dejado de ser un asunto abstracto de aranceles y declaraciones para convertirse en un bloqueo concreto en la cadena de innovación tecnológica. Esta vez, el foco está en Tesla y su robot humanoide Optimus, cuya producción ha quedado parcialmente paralizada por una medida del gobierno chino: restricciones a la exportación de materiales críticos por su posible uso militar.

La noticia revela un punto de inflexión incómodo: las tecnologías de propósito civil (como un brazo robótico) pueden usar exactamente los mismos componentes que un sistema de misiles. Y en un contexto de desconfianza mutua, incluso una empresa como Tesla —reconocida por su innovación, pero también por su cercanía con figuras políticas polarizantes como Donald Trump— entra en la zona gris de la seguridad internacional.

Por si se os habia olvidado como eran estos robots:

Aunque Tesla insiste en su uso exclusivamente industrial, las autoridades del país asiático exigen ahora garantías explícitas de que estos materiales no alimentarán desarrollos militares encubiertos. La implicación es clara: la carrera por la robótica avanzada ya no se libra solo en el laboratorio, sino en las oficinas de comercio exterior y defensa.

🦾 Toolkit:

Una sección dedicada a compartir herramientas, recursos y aplicaciones útiles para la comunidad de Brain and Code

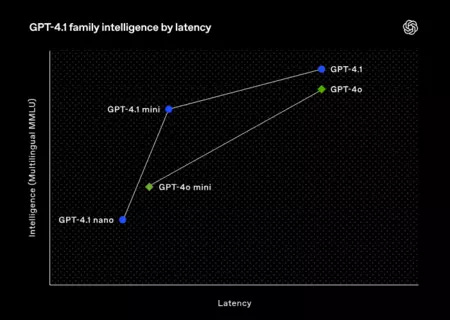

— GPT-4.1 llega oficialmente a ChatGPT: más eficiencia, más precisión, menos fricción

OpenAI ha hecho oficial el despliegue de GPT-4.1 y su versión mini en la interfaz de ChatGPT para los usuarios con planes de pago (Plus, Pro y Team). Tras un mes disponible solo vía API para desarrolladores, el modelo entra ahora en escena para un público más amplio, acompañado de una promesa clara: menos repeticiones, más precisión y una comprensión más fluida de las instrucciones complejas.

Más allá del cambio de nombre (que empieza a exigir un manual de estilo propio), GPT-4.1 representa un salto técnico importante en términos de eficiencia, velocidad y reducción de recursos. La ventana de contexto se amplía hasta un millón de tokens, el tiempo de respuesta mejora un 40%, y los recursos consumidos por solicitud se reducen en un 80%. Todo esto sin que el usuario tenga que “insistir” o reformular tanto como antes: el modelo aprende mejor, con menos.

Este avance no solo impacta en la experiencia de uso para tareas como redacción, codificación o síntesis, sino que redefine la idea de “interacción optimizada”: cada conversación es menos trabajo para el humano y más comprensión contextual por parte del sistema. La IA empieza a anticipar el flujo lógico del usuario, no solo a responder a su input.

Pero el verdadero mensaje detrás de GPT-4.1 no está en los tokens ni en los benchmarks, sino en la consolidación de un nuevo estándar de interfaz cognitiva: modelos cada vez más potentes, cada vez más económicos y cada vez más adaptativos. No se trata solo de usar IA. Se trata de empezar a trabajar con sistemas que aprenden cómo trabajamos. ¿Estamos preparados para redefinir también nuestros propios flujos? ¿O seguimos pensando que los copilotos son solo herramientas y no entornos de colaboración real?

⚡ Corner:

Nuestra recomendación para esta semana:

— Súmate a la edición IX de AI Expert

Quedan pocos días para iniciar una nueva edición del Programa Experto en IA Generativa, diseñado para profesionales que no solo quieren entender la IA, sino usarla de forma avanzada y estratégica en productividad, creatividad y toma de decisiones.

Durante 30 horas de formación intensiva (20 sesiones online) trabajarás desde dentro:

→ Técnicas avanzadas de prompting

→ Diseño y uso de agentes conversacionales

→ Aplicaciones reales en distintos sectores

→ Buenas prácticas, ética y gestión del riesgo

→ Herramientas clave como ChatGPT, Copilot, Claude o Perplexity

Programa Experto en Inteligencia Artificial Generativa | AI Expert Ed. IX: 10/06/2025

€836,00 (precio especial, antes €1.195,00)

AI Expert no es un curso más, es una experiencia formativa para quienes quieren liderar el cambio, no seguirlo.

Matricúlate en: AI Expert IX

— ¿Conoces nuestro canal de YouTube?

Desde hace un tiempo nos encontramos fortaleciendo nuestros canales y precisamente uno de ellos es nuestro canal de youtube: https://www.youtube.com/@brainandcodetech… ¿Ya lo conoces? 🤔

Desde Brain and Code, hemos creado un espacio para compartir conocimiento y demos interesantes sobre el mundo de la tecnología.

Si te interesa la IA generativa, aprender con tutoriales paso a paso, ver demos de proyectos o escuchar la perspectiva de docentes expertos, ¡este es tu lugar! Respondemos muchas de esas preguntas que te surgen sobre la IA y exploramos un montón de temas tecnológicos más.

Pásate por el canal, explora el contenido y ¡no olvides suscribirte para no perderte nada!… Te esperamos: https://www.youtube.com/@brainandcodetech